Velké jazykové modely dokážou generovat text nebo odpovídat na otázky, ale samy o sobě nemají přístup k interním dokumentům, databázím ani aktuálním informacím. Framework LlamaIndex tento problém řeší. Umožňuje propojit AI modely s vlastními daty a vytvářet nad nimi inteligentní vyhledávání, firemní asistenty nebo analytické nástroje.

Co je LlamaIndex

LlamaIndex je open-source framework, který umožňuje propojit velké jazykové modely (LLM) s externími daty, například dokumenty, databázemi nebo API. Slouží jako vrstva mezi AI modelem a datovými zdroji, ze kterých dokáže informace načíst, strukturovat a indexovat, píše web Digital Ocean.

Díky tomu mohou AI aplikace pracovat s konkrétními a aktuálními daty, nikoli jen se znalostmi získanými během tréninku modelu. LlamaIndex se často používá při tvorbě firemních chatbotů, inteligentního vyhledávání v dokumentech nebo analytických nástrojů nad velkými datovými kolekcemi.

Framework je také často součástí architektury Retrieval-Augmented Generation (RAG), kdy systém nejprve vyhledá relevantní informace v datech a teprve poté je předá jazykovému modelu pro vytvoření odpovědi.

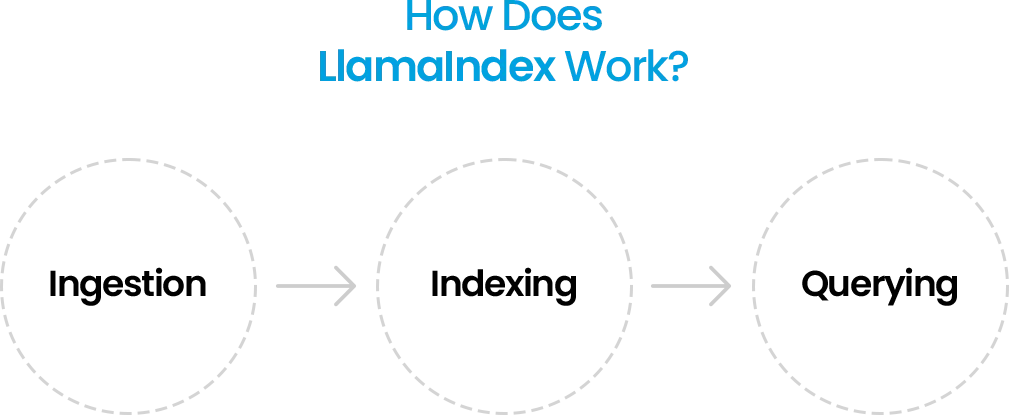

Jak LlamaIndex přesně funguje

Princip fungování LlamaIndexu spočívá v tom, že propojuje jazykový model s externími daty a umožňuje nad nimi provádět dotazy v přirozeném jazyce. Celý proces lze rozdělit do několika kroků:

1) Načtení dat – LlamaIndex dokáže načíst data z různých zdrojů, například z PDF souborů, textových dokumentů, databází, webových stránek nebo cloudových služeb.

2) Příprava a rozdělení dokumentů – velké dokumenty se rozdělí na menší části, aby bylo možné s daty efektivně pracovat a přesněji vyhledávat relevantní informace.

3) Vytvoření indexu – jednotlivé části dokumentů se uloží do indexu (například vektorového), který umožňuje rychlé vyhledávání podle významu textu.

4) Vyhledání relevantních informací – při dotazu uživatele systém nejprve vyhledá části dokumentů, které jsou pro danou otázku nejrelevantnější.

5) Generování odpovědi – vyhledané informace se přidají do kontextu jazykového modelu, který na jejich základě vytvoří odpověď.

Tento postup je typický pro architekturu Retrieval-Augmented Generation (RAG), která umožňuje AI pracovat s aktuálními a konkrétními daty.

Klíčové komponenty LlamaIndexu

LlamaIndex se skládá z několika základních komponent, které společně umožňují propojit jazykové modely s externími daty a pracovat s nimi v AI aplikacích.

- Data connectors – slouží k načítání dat z různých zdrojů. LlamaIndex dokáže pracovat například s textovými soubory, PDF dokumenty, databázemi, webovými stránkami nebo cloudovými službami. Tyto konektory převádějí data do jednotné struktury dokumentů, se kterou může framework dále pracovat.

- Indexy – organizují data tak, aby bylo možné rychle vyhledat relevantní informace. Dokumenty se při zpracování rozdělí na menší části a uloží do struktury, která podporuje efektivní vyhledávání. LlamaIndex podporuje různé typy indexů, například vektorové indexy, které umožňují hledat informace podle významu textu.

- Query engine – zajišťuje zpracování dotazů uživatelů. Když uživatel položí otázku v přirozeném jazyce, tato komponenta vyhledá nejrelevantnější části dokumentů v indexu a připraví je jako kontext pro jazykový model.

- Integrace s AI modely a nástroji – LlamaIndex lze propojit s různými jazykovými modely, vektorovými databázemi nebo dalšími frameworky pro vývoj AI aplikací. Díky tomu mohou vývojáři vytvářet komplexní systémy, které kombinují AI modely s vlastními daty a dalšími nástroji.

LlamaIndex vs. LangChain

LlamaIndex a LangChain patří mezi nejznámější frameworky pro vývoj aplikací využívajících velké jazykové modely. Přestože se často používají společně, jejich role je odlišná.

LlamaIndex se zaměřuje především na práci s daty. Slouží k načítání dokumentů z různých zdrojů, jejich strukturování, indexaci a vyhledávání relevantních informací. Hlavním cílem je umožnit jazykovým modelům pracovat s externími daty, například s dokumenty, databázemi nebo firemními znalostními bázemi.

LangChain je naopak framework určený pro orchestraci AI aplikací. Pomáhá vytvářet komplexnější workflow, ve kterých jazykové modely spolupracují s různými nástroji, API nebo dalšími službami. Umožňuje například vytvářet více krokové procesy, řídit interakce mezi modely a integrovat AI do širších softwarových systémů.

V praxi se proto tyto nástroje často kombinují. LlamaIndex zajišťuje práci s daty a vyhledávání relevantního kontextu, zatímco LangChain řídí logiku aplikace, propojuje jednotlivé nástroje a orchestruje celý proces.

Taková kombinace umožňuje vytvářet pokročilé AI aplikace, například inteligentní asistenty nebo systémy pro analýzu dokumentů.

Propojení AI s daty jako nový standard

Velké jazykové modely jsou velmi schopné, ale bez přístupu k aktuálním nebo interním datům mají omezené využití. Samotný model sice dokáže generovat text nebo odpovídat na otázky, ale nedokáže pracovat s konkrétními dokumenty, databázemi nebo firemními informacemi.

Frameworky jako LlamaIndex tento problém řeší tím, že umožňují jazykovým modelům pracovat s reálnými daty. Díky tomu mohou firmy vytvářet například znalostní asistenty nad interní dokumentací, analytické nástroje pro práci s daty, inteligentní vyhledávání nebo autonomní AI agenty.

Vývoj AI aplikací se tak postupně posouvá od samostatných modelů k systémům, které kombinují jazykové modely s externími daty a dalšími nástroji. Frameworky jako LlamaIndex proto představují důležitý krok v této transformaci. Umožňují vytvářet aplikace, které nejsou jen generátory textu, ale skutečnými digitálními asistenty pracujícími s reálnými informacemi.